ChatGPT Salute: OpenAI entra nella sanità

Negli ultimi anni l’intelligenza artificiale ha dimostrato di poter semplificare attività informative, organizzative e linguistiche in moltissimi settori. In sanità, però, la soglia di attenzione è diversa e non basta che un sistema sia utile. Deve essere affidabile, prudente, progettato per trattare dati sensibili e inserito in un contesto in cui la decisione finale resta umana. È in questo spazio che si colloca ChatGPT Salute, la nuova iniziativa presentata da OpenAI all’inizio del 2026. Un’esperienza dedicata dentro ChatGPT e pensata per accompagnare le persone nella comprensione delle proprie informazioni sanitarie. L’obiettivo dichiarato non è formulare diagnosi né sostituire il rapporto con il medico, ma aiutare gli utenti a sentirsi più preparati e sicuri nell’orientarsi dentro il proprio percorso di salute.

L’importanza di uno spazio dedicato

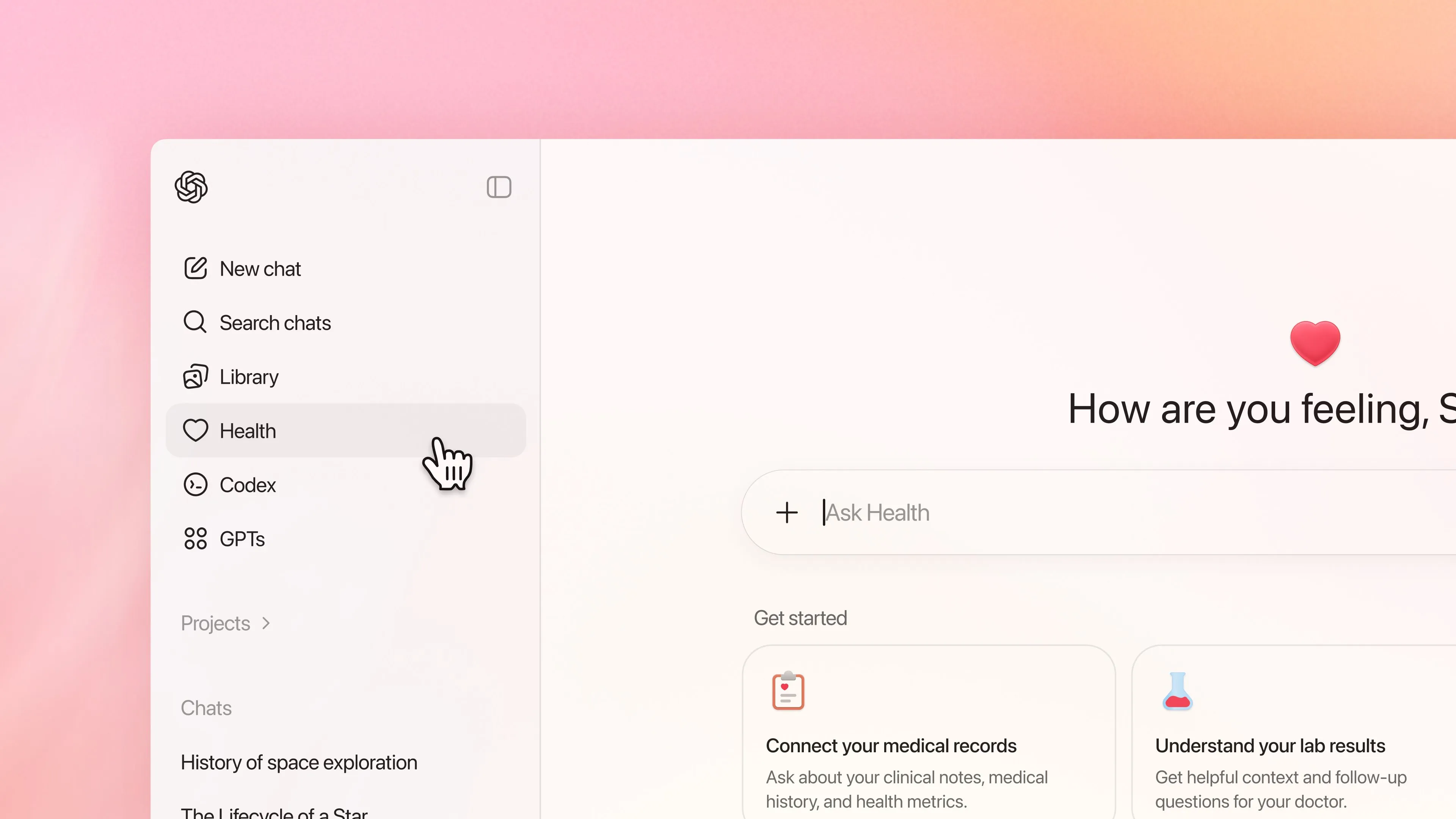

Health vive in uno spazio distinto dalle altre chat dell’utente. Le conversazioni, le app collegate e i file caricati in quest’area vengono conservati separatamente dal resto dell’esperienza, con memorie dedicate che mantengono il contesto sanitario confinato in quello spazio specifico.

In un prodotto destinato a ospitare informazioni sulla propria storia clinica, la separazione del contesto è parte integrante della promessa di sicurezza. L’utente può comunque vedere la cronologia delle chat salute e tornarci facilmente, ma il contenuto resta circoscritto all’area.

OpenAI prova così a costruire non solo una funzione in più, ma un perimetro operativo distinto, per rendere l’interazione sanitaria meno dispersiva e più controllabile.

Supporto informativo per i pazienti

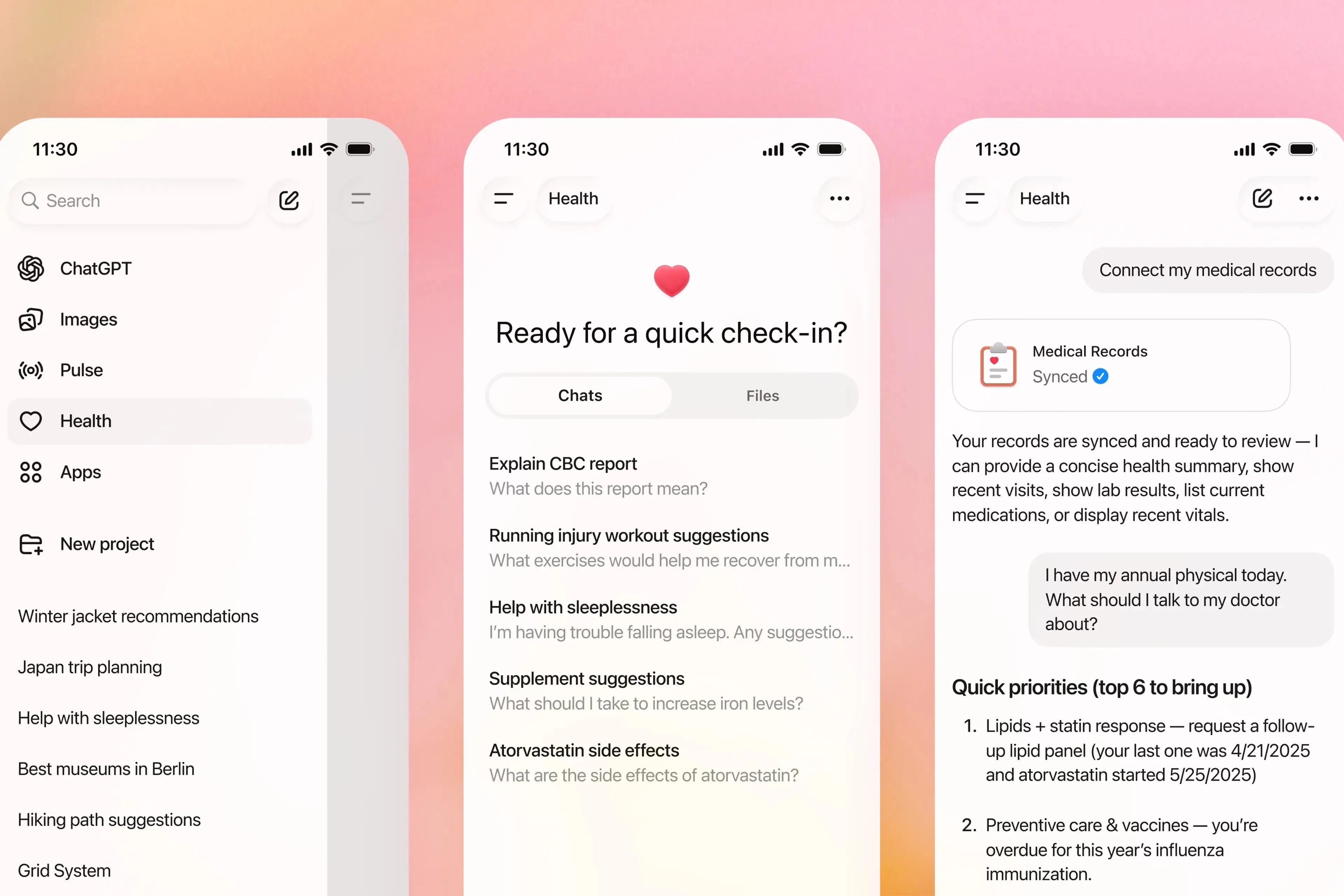

Dal lato degli utenti, la funzione di ChatGPT Salute è presentata come uno strumento che può aiutare a comprendere meglio ciò che riguarda la propria salute, senza pretendere di sostituire il medico. Questo significa, in termini concreti, potersi preparare a una visita, chiarire un referto, organizzare le domande da porre a uno specialista, contestualizzare sintomi o indicazioni generali sullo stile di vita e orientarsi più consapevolmente dentro informazioni che spesso appaiono troppo tecniche o difficili da leggere. La logica non è quella della diagnosi automatica, ma quella della mediazione cognitiva. ChatGPT Salute prova a rendere più leggibile ciò che per molti pazienti resta opaco. È un punto rilevante perché gran parte del carico emotivo e decisionale della sanità contemporanea nasce proprio dall’asimmetria informativa. Avere uno strumento che renda più comprensibile la documentazione sanitaria può aumentare la qualità del dialogo con il professionista.

Cartelle cliniche e app collegate

Uno degli aspetti più delicati riguarda il trattamento dei dati. OpenAI dichiara che in ChatGPT Salute gli utenti possono collegare app sanitarie e caricare file per integrare le proprie informazioni di salute nell’esperienza conversazionale. Proprio per questo la questione privacy è centrale. La documentazione ufficiale specifica che i dati personali di salute inseriti non vengono usati per addestrare i foundation model di OpenAI. Inoltre l’azienda afferma di non vendere queste informazioni a terze parti e di conservarle con misure di sicurezza dedicate, compresa la cifratura dei dati archiviati. È un passaggio importante, perché la possibilità di usare un assistente AI su temi sanitari dipende anche dalla fiducia nell’isolamento dei dati sensibili rispetto ai normali circuiti di sviluppo dei modelli.

Layer di supporto per professionisti della salute

Quando il discorso si sposta dai pazienti ai professionisti, OpenAI distingue chiaramente il prodotto consumer dall’offerta enterprise destinata a clinici, amministratori e ricercatori, denominata ChatGPT per il settore sanitario. Qui il focus cambia. Non si tratta più soltanto di aiutare una persona a capire meglio le proprie informazioni, ma di supportare il lavoro clinico e organizzativo con un’infrastruttura sicura. OpenAI spiega che questa soluzione è progettata per ridurre il carico amministrativo, supportare il ragionamento basato sulle evidenze e produrre output comprensibili per i pazienti, il tutto all’interno di uno spazio di lavoro con controlli di sicurezza, governance e conformità pensati per contesti sanitari. La promessa è quella di alleggerire alcune attività collaterali che assorbono tempo prezioso. Il professionista resta al centro del processo decisionale, mentre l’AI interviene come supporto alla sintesi, alla ricerca, alla riorganizzazione delle informazioni e alla comunicazione.

Rapporto tra AI e responsabilità clinica

L’arrivo di ChatGPT Salute riapre inevitabilmente una questione più ampia. Cosa significa introdurre un sistema generativo in un ambito dove errore, ambiguità e fraintendimento possono avere conseguenze concrete sulle persone?

Le fonti ufficiali di OpenAI mantengono, su questo punto, una linea prudente. ChatGPT Salute viene presentato come supporto al benessere personale e all’orientamento informativo, non come dispositivo diagnostico. ChatGPT per il settore sanitario viene descritto come strumento a supporto del ragionamento clinico e della produttività, non come sostituto del giudizio professionale. È una distinzione fondamentale. L’AI può velocizzare sintesi, migliorare leggibilità, aiutare nella preparazione e persino facilitare il rapporto tra medico e paziente. Ma la responsabilità clinica, interpretativa e decisionale resta umana.

Privacy, affidabilità e confini d’uso

Ogni innovazione sanitaria basata sull’AI viene misurata non solo per ciò che promette, ma per i confini che riesce a rispettare. Nel caso di ChatGPT Salute, i tre temi decisivi sono evidenti. Il primo è la privacy, affrontata da OpenAI con uno spazio separato, controlli dedicati e l’esclusione di default dei dati sanitari dal training dei modelli. Il secondo è l’affidabilità, che non dipende soltanto dalla qualità linguistica delle risposte, ma dalla capacità del sistema di restare entro il proprio perimetro informativo. Il terzo è la responsabilità, cioè la chiarezza con cui il prodotto viene presentato come supporto e non come sostituzione del medico. Se questa architettura reggerà nel tempo, ChatGPT Salute potrà diventare un’interfaccia importante tra persone, informazioni cliniche e sistema sanitario. In caso contrario, il rischio sarà quello tipico di molte tecnologie conversazionali, apparire più autorevoli di quanto sia prudente essere.

Un segnale di evoluzione

ChatGPT Salute va letto come segnale di una fase nuova dell’AI. OpenAI non si limita più a proporre un assistente generalista capace di rispondere anche su temi medici, ma costruisce un ambiente specifico per la salute e lo accompagna con un’offerta distinta per il settore sanitario professionale. Questa biforcazione è significativa. Da un lato riconosce che l’uso personale della tecnologia sanitaria richiede tutele, memoria separata e controllo sui dati. Dall’altro ammette che il lavoro clinico reale ha bisogno di una piattaforma enterprise con regole, sicurezza e accesso a fonti affidabili. Il punto, quindi, non è solo che l’AI entri nella medicina. È il modo in cui ci entra. Se saprà restare strumento di supporto, di comprensione e di alleggerimento del carico cognitivo e amministrativo, potrà rafforzare il sistema sanitario. Se invece verrà letta come scorciatoia decisionale, allora il problema non sarà tecnologico, ma culturale.